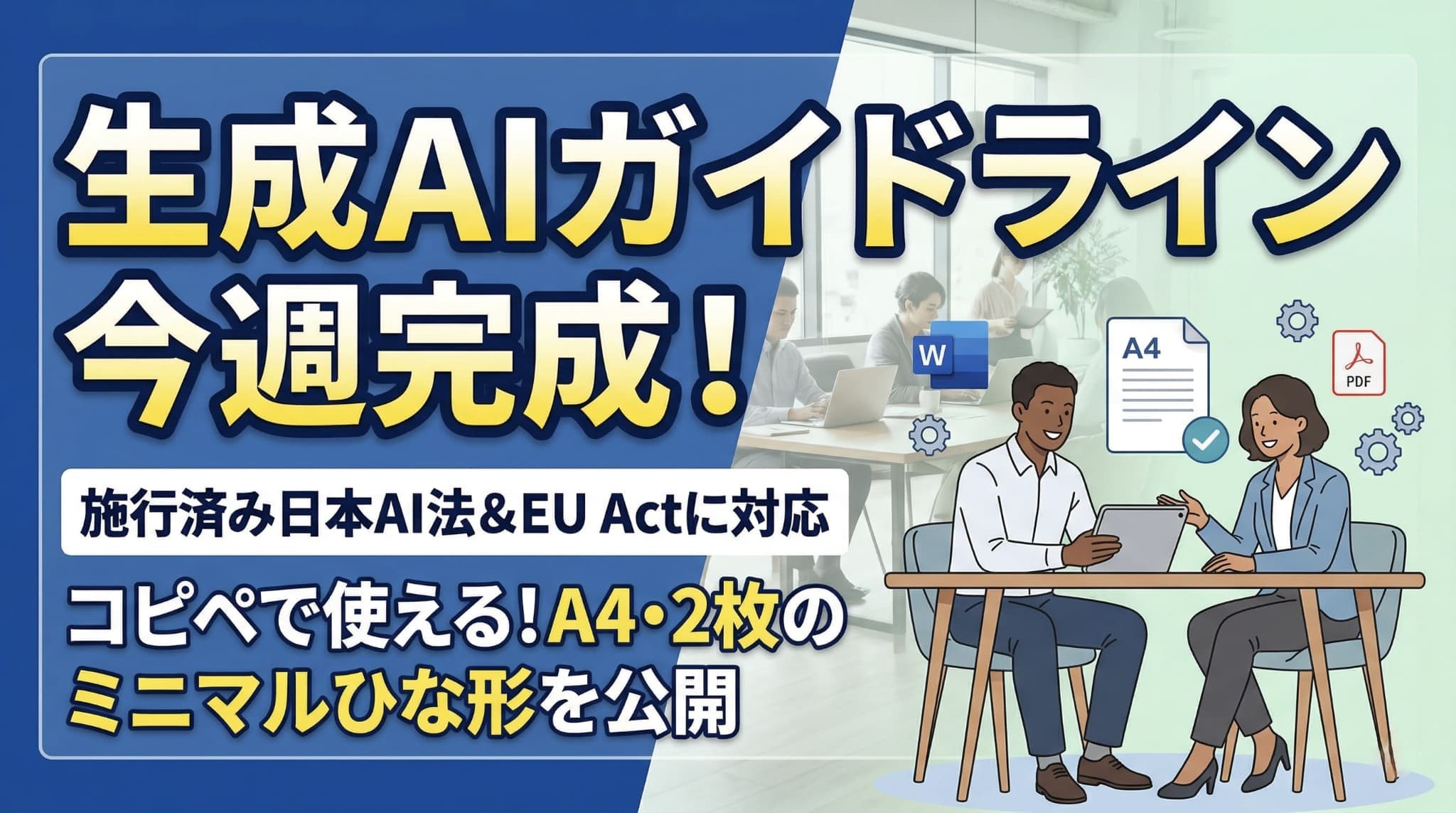

「ガイドラインを作らなきゃ」と思って半年が経っている人へ

正直に言う。この記事は、私自身への反省から書いている。

中小企業のAI導入を手伝う仕事をしていて、「まず社内ガイドラインを整備しましょう」と何度もクライアントに言ってきた。ところが、その「まず」がいつまでも終わらない。法務部はない。情シスは兼務1人。総務が片手間で見ている。ガイドラインの「ひな形」を検索すると、JDLAや経産省のPDFが出てくるけれど、どれも20〜30ページある。読むだけで1日が終わる。結局、来月やろうが半年になる。

その半年のあいだに、現場では何が起きているか。 禁止や放置は問題を地下に潜らせるだけだ。エルテスの調査(2026年1月公表)によれば、業務で生成AIを利用している人のうち約5人に1人が、会社が許可していないツールを使っている。社内にガイドラインが「ない」企業ほど、シャドーAI率が有意に高い。IIJの調査では、生成AIガイドラインが未整備の企業は63%に上る。つまり、作らなきゃと思いつつ作れていない会社が過半数なのだ。

この記事では、JDLAの公開テンプレート、経産省・総務省の「AI事業者ガイドライン」、そして私が中小企業の現場で実際に使って機能した運用ルールを組み合わせて、「今週中に完成させられるA4・2枚のミニマルガイドライン」のテンプレートを公開する。10ページの完璧な文書を3ヶ月かけて作るより、2枚の暫定版を今週配る方が、シャドーAIは確実に減る。

なぜ2026年4月の「今」がデッドラインなのか

「いつか作ればいい」が通用しなくなった理由は、法規制の環境が2025〜2026年で一気に変わったからだ。

① 日本AI法の全面施行(2025年9月)

正式名称は「人工知能関連技術の研究開発及び活用の推進に関する法律」。2025年5月に成立し、9月に全面施行された(内閣府 AI法全面施行)。罰則規定のないソフトロー型の法律ではあるものの、国が「AI事業者が遵守すべき事項を含む指針」を整備し、悪質な事案には調査・指導・助言を行う権限が規定されている。つまり、法的な根拠を持った「お前の会社、ガイドラインないの?」が成立する世界になった。

② EU AI Act の完全適用(2026年8月)

ハイリスクAIに関する規制を含むEU AI規則が、2026年8月に完全適用となる(PwC Japan 解説)。「うちは国内取引だけだから関係ない」と思うかもしれないが、EU AI Actには域外適用条項がある。AIの出力がEU域内で使用される場合、提供者・利用者がEU外でも適用対象になり得る(日立コンサルティング 解説)。取引先の取引先がEU企業だった場合、「うちは関係ない」が通らないリスクがある。違反時の制裁金は最大でグローバル年間売上高の7%、または3,500万ユーロのいずれか高い方だ。

③ 経産省・総務省「AI事業者ガイドライン」第1.1版(2025年3月)

2024年4月に公開された第1.0版のアップデートとして、2025年3月28日に第1.1版が公開された(総務省 PDF / 経済産業省)。AI事業者を「開発者」「提供者」「利用者」の3類型に分け、それぞれの遵守事項を整理している。中小企業は多くの場合「AI利用者」に該当するが、社内でRAGを組んだりAPI経由のワークフローを構築していれば「AI提供者」に近い責任を負うケースもある。

この3つが同時に動いている2026年4月は、「ガイドラインがないこと」自体がリスクになるタイミングだ。完璧でなくていい。「うちには暫定版がある」と言える状態を、先に作る。

「10ページのガイドライン」が中小企業で機能しない理由

本題に入る前に、なぜ「ちゃんとしたガイドライン」が中小企業ではワークしないのかを押さえておく。これは自分自身の失敗経験でもある。

失敗①:A4・10ページのガイドラインを作ったら、誰も読まなかった

40人規模の商社で、JDLAのテンプレートをベースに10ページの「生成AI利用規程」を作った。目次、定義、利用可能ツール一覧、禁止事項、罰則規定、改訂手続き……法務的にはきちんとした文書だった。全社メールで配布して、朝礼で社長が「読んでおくように」と一言添えた。

1ヶ月後、現場にヒアリングに行ったら、10ページ全部を読んだ人は2人しかいなかった。「導入率57.7%なのに利用率1割」の記事で書いた「セキュリティ萎縮」と同じ構造で、ルールが重厚すぎると現場は「全部ダメ」と解釈して動かなくなる。しかもその2人は情シス兼務の総務担当と、もともとAIに詳しいエンジニアだった。営業、経理、倉庫のスタッフは「あ、なんか来てましたね」の一言。禁止されているツールを個人スマホで使っている人もそのままだった。

失敗②:規程はあるのに「何がアウトか」が現場に伝わっていなかった

もう1社、士業事務所での話。前任のコンサルが作成した生成AI利用規程は、きちんとしたWord文書で社内サーバーに置いてあった。ところが、現場の事務員に「ChatGPTに顧客の相談内容を貼り付けていいですか?」と聞かれて、規程を読み直したら「機密情報の入力は禁止する」としか書いていない。「顧客の相談内容」が「機密情報」に該当するのかどうか、現場は判断できない。結局、全員が「怖いから何も入れない」か「気にせず全部入れる」の二極化していた。

この2つの失敗から学んだのは、中小企業のガイドラインに必要なのは網羅性ではなく「判断に迷う時間をゼロにする具体性」だということだ。

テンプレート公開:A4・2枚の「生成AI利用ガイドライン」

ここから、実際にコピペで使えるテンプレートを掲載する。JDLAが公開している「生成AIの利用ガイドライン」のひな形(JDLA資料室)と、経産省・総務省の「AI事業者ガイドライン」第1.1版の「AI利用者」向け指針をベースに、中小企業向けに最小構成に削り込んだものだ。

テンプレートの設計思想

先に設計思想を説明しておく。

- A4で2枚以内:印刷して壁に貼れる。全社員が5分で読み切れる。

- 「禁止」より「これを使え」を先に書く:エルテスの調査が示した通り、「ガイドラインがある」だけでシャドーAI率は下がる。心理的抵抗を生む「禁止」を最初に持ってこない。

- 判断基準は○×の二択にする:「機密情報」のような曖昧な言葉を使わず、具体的な情報カテゴリで○×をつける。

- 違反時の対応は1行だけ:詳細な懲戒規定は就業規則側に委ねる。ガイドライン側では「重大な情報漏洩の場合、就業規則に基づき懲戒処分の対象となります」の1行で済ます。

【テンプレート本文】

〔社名〕 生成AI利用ガイドライン(暫定版)

施行日: 20XX年XX月XX日 | 改訂日: ―― | 管理者: 〔情シス担当者名 or 総務担当者名〕

1. 目的

本ガイドラインは、当社における生成AI(ChatGPT、Copilot、Gemini、Claude等の大規模言語モデルを利用したサービス)の業務利用について、情報漏洩の防止と業務品質の維持を目的として定めるものです。

2. 利用が承認されたツール

以下のツールのみ、業務目的での利用を承認します。

ツール名 契約形態 利用可能な社員 管理者 〔例:ChatGPT Business〕 〔法人契約〕 〔全社員 / 対象部署名〕 〔担当者名〕 〔例:Microsoft 365 Copilot〕 〔法人契約〕 〔対象部署名〕 〔担当者名〕 上記以外の生成AIサービス(個人契約のChatGPT無料版・Plus、Gemini、Claude、各種AI議事録サービス等)を業務目的で利用することは禁止します。 判断に迷う場合は、管理者〔名前〕に確認してください。

3. 入力してよい情報・入力してはいけない情報

情報の種類 入力可否 具体例 社内の一般的な業務知識 ✅ 可 業界用語の説明、一般的な文書の下書き、翻訳 公開済みの自社情報 ✅ 可 自社Webサイトに掲載済みの情報、公開プレスリリース 社内の非公開情報 ❌ 不可 未発表の製品・サービス情報、社内会議の議事録、売上・利益等の非公開財務数値 顧客・取引先の情報 ❌ 不可 顧客名、連絡先、契約内容、見積金額、商談メモ 個人情報 ❌ 不可 社員・顧客の氏名、住所、電話番号、マイナンバー、健康情報 契約書・法務文書 ❌ 不可 NDA、業務委託契約書、知的財産に関する文書 ソースコード・設計図 ❌ 不可 自社開発のソースコード、製品の設計図面・仕様書 迷ったら「入れない」。判断できない場合は、管理者〔名前〕に確認してから利用してください。

4. 利用上のルール(5か条)

① 出力をそのまま社外に出さない。 AIが生成した文章・データは、必ず自分の目で確認し、事実関係を検証してから使用すること。「AIがそう書いたので」は社外への説明として認められません。

② 著作権に注意する。 AIが生成した文章・画像・コードに、他者の著作物が含まれている可能性があります。社外に公開する成果物に使用する場合は、出典の確認と管理者への事前相談を行ってください。

③ 重要な意思決定をAIだけに委ねない。 採用・人事評価・法的判断・医療判断・与信判断など、人の権利に影響する決定にAIの出力をそのまま使用することを禁止します。

④ 利用ログを消さない。 承認済みツールでのチャット履歴は業務記録として扱います。意図的な削除は禁止します。

⑤ 不具合・誤出力は報告する。 AIの出力に明らかな誤り、不適切な内容、情報漏洩の疑いがあった場合は、管理者〔名前〕にすみやかに報告してください。

5. 違反時の対応

本ガイドラインに違反し、重大な情報漏洩・法令違反が発生した場合は、就業規則に基づき懲戒処分の対象となることがあります。ただし、本ガイドラインの趣旨は「罰すること」ではなく「事故を未然に防ぐこと」です。判断に迷った際の事前相談や、ヒヤリハットの報告は、評価上不利に扱いません。

6. 改訂について

本ガイドラインは暫定版です。〔3ヶ月後の日付〕を目処に、利用状況を踏まえて改訂します。現場から「この場面の判断が分からない」という声があれば、管理者〔名前〕まで随時ご連絡ください。改訂のたびにバージョン番号を付与し、変更点を全社に通知します。

テンプレートの使い方:カスタマイズの3ステップ

テンプレートをそのまま配布しても機能する。ただし、自社に合わせて以下の3点だけカスタマイズすると精度が上がる。

ステップ1:「承認ツール」の欄を埋める。 会社が法人契約しているAIサービスを書く。まだ法人契約がなければ、ChatGPT Businessは2名・月25ドル/ユーザーから契約可能なので、まずヘビーユーザー2名で始めてここに書く。

ステップ2:「入力不可」の具体例を自社に合わせる。 テンプレートの例はあくまで汎用版だ。自社特有の機密情報(例:製造業なら図面番号、医療系なら患者情報、士業なら依頼者の相談内容)があれば、具体例の欄に追記する。ここが曖昧だと、先ほどの士業事務所の二の舞になる。

ステップ3:管理者の名前を実名で入れる。 「情報システム部」ではなく、「総務 山田」のように個人名を入れる。中小企業では「部署に聞く」が機能しないことが多い。「この人に聞けばいい」を明確にする方が、問い合わせのハードルが下がる。

このテンプレートの法的な根拠と限界

テンプレートの中身について、「これで法的に大丈夫なのか」は当然の疑問だろう。先に答えを書く。このテンプレートは法的文書ではなく、運用ルールの最小構成だ。法的な完全性が必要な場面では、弁護士の確認を受けてほしい。

そのうえで、このテンプレートがカバーしている法的・規範的根拠を整理しておく。

カバーしている範囲:

- 個人情報保護法:入力禁止の情報カテゴリに「個人情報」を明記することで、第三者提供の規制(法第27条)に対応。

- 不正競争防止法:「非公開情報の入力禁止」が営業秘密の管理措置(法第2条第6項)の一環として機能。ただし、これだけでは「秘密管理性」の要件を満たすとは言い切れないため、秘密情報管理規程との併用が望ましい。

- AI事業者ガイドライン(第1.1版):「AI利用者」としての安全性・透明性・アカウンタビリティの確保について、ルール4の「出力確認義務」とルール3の「重要決定への利用制限」で対応(経産省・総務省 第1.1版)。

- 日本AI法(2025年施行):現時点ではソフトロー型のため直接の罰則はないが、「ガイドラインが存在すること」自体が、AI戦略本部の指導・助言に対する企業側の防御材料になる(BUSINESS LAWYERS 解説)。

カバーしていない範囲:

- EU AI Act への完全対応:ハイリスクAIの分類と適合性評価は、このテンプレートの範囲外。EU向け取引がある企業は、デロイト トーマツの解説を参照し、別途対応が必要。

- 著作権法の詳細運用:ルール2で「著作権に注意する」と記載しているが、AI生成物の著作権帰属の問題は法的に未確定の領域が多い。商用利用する場合は個別に法務確認を推奨。

- 懲戒規定の詳細:就業規則側に委ねている。ガイドラインと就業規則の紐付けは、社労士または弁護士に確認のこと。

「サムスン事件」を自社に置き換えて読む——なぜ「入力禁止リスト」が核心なのか

テンプレートの中で最も重要なのは、セクション3の「入力してよい情報・入力してはいけない情報」の表だ。ここに具体性がないと、ガイドラインは壁に貼った標語と変わらない。

その理由を、有名な事例で説明する。

2023年3月、サムスン電子の社員3名が、社内のソースコード、テストシーケンス、社内会議の内容をChatGPTに入力し、OpenAI側にデータが渡ってしまった事件が報じられた(AdGuard ブログ / 侍エンジニア 解説)。サムスンは事前に「社内情報のセキュリティに注意し、個人情報を入力しないこと」と通達していた。通達はしていたのに、漏洩は起きた。

なぜか。「社内情報のセキュリティに注意」は、何が社内情報なのかを定義していないからだ。エンジニアにとってソースコードは「自分が書いたもの」であって、「社内機密」という実感がなかった。会議の議事録も「自分のメモ」であって「秘密情報」だとは思わなかった。

中小企業でもまったく同じことが起きる。先に挙げた士業事務所では、「顧客の相談内容」が「機密情報」に該当するかどうかが現場では判断できなかった。テンプレートのセクション3で情報カテゴリごとに具体例付きで○×をつけているのは、この問題を潰すためだ。曖昧な上位概念(「機密情報」「センシティブデータ」)を使わず、現場の人間が自分の手元にある情報を見て即座に判断できる粒度で書く。

【現場でのつまづき】テンプレートを配った「後」に起きること

テンプレートを作って配布する。ここまでは1日で終わる。問題は、配った後だ。私が3社で経験した「配布後あるある」を共有する。

つまづき①:「これ読みましたけど、結局ChatGPT使っていいんですか?」

テンプレートの趣旨は「承認ツールなら使ってよい」だが、現場は「禁止事項が並んでいる文書 = ダメと言われている」と受け取る。特に、過去に「ChatGPT禁止令」を出していた会社では、社員側に「AIは触ると怒られるもの」という先入観が残っている。

対策: 配布時に、口頭(朝礼、Slack、Teams)で「このガイドラインは"使うな"ではなく"こう使え"という文書です」と一言添える。テンプレートの構成を「承認ツール」から始めているのはこのためだが、文書だけでは伝わらない。声で補完する。

つまづき②:「入力禁止の表、うちの業務だと判断できないケースが多い」

テンプレートの○×表は汎用版なので、自社特有のグレーゾーンは必ず出てくる。「取引先から共有された資料の一部を要約してもいいか」「製品の公開スペック表をベースにAIに比較表を作らせてもいいか」——こういう質問が、配布後1〜2週間で必ず来る。

対策: 来た質問を管理者がメモしておき、月に1回、○×表に「追加項目」として反映する。これがガイドラインの生きた改訂プロセスになる。テンプレートにセクション6「改訂について」を入れているのは、この運用を前提にしているからだ。

つまづき③:「個人スマホまでは止められないんですが」

これは、「ChatGPT禁止令」の記事でも書いた通り、技術的に100%止める方法は今のところない。中小企業でCASBやMDMをフル装備するのは非現実的だ。

対策: 個人スマホでの利用を「ゼロにする」のではなく、「承認ツールのほうが楽だから個人ツールを使う動機がなくなる」状態を目指す。最大の発生源である会議の議事録作成には、会社公式のAI議事録ツールを1つ置く。テンプレートで禁止するだけでなく、禁止される行為の「正規の代替手段」をセットで用意するのが鉄則だ。

【独自の工夫点】「配って終わり」にしない3つの仕掛け

テンプレートは配布がゴールではない。定着させるための仕掛けを3つ紹介する。

① 「1分ルール説明」を朝礼に挟む——週1回、1ルールずつ

テンプレートの5か条を、毎週月曜の朝礼で1条ずつ、1分間だけ説明する。5週間で1周する。説明するのは管理者ではなく、各部署のメンバーに持ち回りで任せる。自分で説明する側に回ると、ルールの理解度が強制的に上がる。

実際にやった製造業(45人規模)では、5週目に「ルール①は分かるけど、自分の業務だとこういうケースはどうなるんですか」という質問が営業部から出始めた。この質問が出た時点で、ガイドラインは「壁に貼ってある紙」から「自分に関係あるルール」に変わっている。

② 「ヒヤリハット共有チャンネル」を作る

SlackでもTeamsでもいい。「#ai-hiyarihatto」のようなチャンネルを1つ作り、AIの利用で「あ、これ危なかったかも」と思った体験を書き込む場所にする。

ポイントは、報告した人を絶対に否定しない運用ルールを徹底すること。テンプレートのセクション5に「ヒヤリハットの報告は、評価上不利に扱いません」と入れているのはこのためだ。評価に響くなら、誰も書かない。

③ 3ヶ月後に「v1.1」を出す——改訂すること自体がメッセージになる

テンプレートを「暫定版」と明記しているのは、3ヶ月後の改訂を最初から予定に組み込むためだ。3ヶ月間で集まった質問、ヒヤリハット、承認ツールの追加・変更を反映して「v1.1」を出す。

この改訂行為自体が、「会社はAI利用のルールを真面目にアップデートしている」という社内メッセージになる。「中小企業AI導入 最初の90日」の記事でも書いた通り、AI導入プロジェクトは「続けること」が最も難しい。ガイドラインの定期改訂は、その「続いている」状態を社内に可視化する仕掛けでもある。1回出して放置されたガイドラインと、四半期ごとに更新されるガイドラインでは、現場の信頼度がまったく違う。

JDLAテンプレートとの違い——なぜ「最小版」を別途作ったのか

「JDLAが無料でひな形を公開しているなら、それを使えばいいのでは?」という疑問に答えておく。

JDLAの「生成AIの利用ガイドライン」(JDLA資料室)は、組織向けのひな形として非常によくできている。利用目的の明確化、入力情報の制限、出力の確認義務、著作権・商標への配慮、免責事項まで網羅されていて、企業規模を問わず参照すべき良質なドキュメントだ。

ただし、JDLAテンプレートは「必要な論点がすべて揃っている」ことが強みであり、同時に中小企業にとっては「論点が多すぎて現場が消化しきれない」という弱点にもなる。法務部が読んで社内調整に使う分にはベストだが、「総務が兼務で、来週の朝礼までに配りたい」という中小企業の現場では、読んで理解して自社版に加工するプロセスだけで数週間かかる。

本記事のテンプレートは、JDLAテンプレートのサブセットという位置づけだ。JDLAが示した論点のうち、中小企業の現場で「これがないと事故が起きる」最小限を抽出している。将来的にガイドラインを拡充する際は、JDLAテンプレートの項目を順次追加していく形で使ってほしい。

よくある質問

Q1. テンプレートは無料で使っていいですか?改変は?

はい。本記事のテンプレートはそのままコピペして社内利用いただいて構いません。社名や情報カテゴリの加筆・修正も自由に行ってください。ただし、法的な責任は各社の運用に帰属します。重要な判断が伴う場合は、弁護士・社労士に確認のうえご利用ください。

Q2. 法人契約のAIツールがまだない場合、どうすればいいですか?

テンプレートの「承認ツール」欄を空欄のまま配布するのは避けてください。それは実質的に「全面禁止」と同じです。ChatGPT Businessは2名から月額25ドル/ユーザーで契約可能で、入力データがデフォルトで学習に使われない設定になっています。まず2席で始め、ガイドラインと同時に配布するのが現実的です。詳しくは「ChatGPT禁止令」の記事をご覧ください。

Q3. 承認ツール以外にも「試したい」と言ってくる社員がいます

イノベーションの芽を摘みたくない気持ちは分かりますが、検証なしに個人判断で新しいツールを業務投入するのはシャドーAIの入り口です。テンプレートの「判断に迷う場合は管理者に確認」の導線で、「使いたいツールがあれば申請してもらい、管理者がデータ処理規約を確認してから承認する」というプロセスを回すのが安全です。3ヶ月ごとの改訂で、検証済みのツールを承認リストに追加していけます。

Q4. AI導入の最初のステップとしてガイドラインは適切ですか?

はい。「中小企業AI導入 最初の90日」の記事で書いた通り、AI導入の最初の30日で「利用ルールの策定」が最優先タスクの1つです。ルールなしにツールだけ配ると、利用率が伸びないか(「現場が拒否する5つの正体」の記事参照)、シャドーAIが増えるかの二択になります。

Q5. ガイドラインを作ったら、それを経営層にどう説明すればいいですか?

「ガイドラインを作ること」自体はコストゼロだが、承認ツールの法人契約には予算が必要になる。その費用対効果をどう説明するかは、次の記事(AI導入のROI算出テンプレート)で詳しく解説する予定です。

まとめ:「完璧な10ページ」より「不完全な2枚」を今週配る

最後に、この記事の要点を整理する。

- 生成AIガイドラインが未整備の企業は63%(IIJ調査)。ガイドラインがない企業ほどシャドーAI率が高い(エルテス調査)。

- 日本AI法の全面施行(2025年9月)とEU AI Actの完全適用(2026年8月)により、「ガイドラインがないこと」自体が法的リスクになる局面に入った。

- 中小企業では10ページの完璧なガイドラインは読まれない。A4・2枚、5分で読める最小構成が機能する。

- テンプレートの核心は「入力してよい情報・してはいけない情報」の具体的な○×表。曖昧な上位概念(「機密情報」)ではなく、情報カテゴリと具体例で書く。

- 配布後は、朝礼での1分説明(週1回)、ヒヤリハット共有チャンネル、3ヶ月後のv1.1改訂の3つで定着させる。

完璧なガイドラインを作ろうとして半年止まっているなら、今日この記事のテンプレートをコピペして、自社の承認ツール名と管理者名だけ入れて、明日の朝礼で配ってほしい。不完全でいい。「うちにはルールがある」という状態を先に作ることが、シャドーAIを止める最初の一歩になる。

参考リンク

- エルテス『【実態調査】生成AI利用者の約5人に1人が「シャドーAI」リスク』 https://eltes.co.jp/news/20260119

- IIJ『「生成AIガイドライン」未整備は63%。情報不足や他業務で忙しいことが課題に』 https://ent.iij.ad.jp/articles/8954/

- JDLA(日本ディープラーニング協会)『生成AIの利用ガイドライン』 https://www.jdla.org/document/

- 経済産業省・総務省『AI事業者ガイドライン(第1.1版)』 https://www.soumu.go.jp/main_content/001002576.pdf

- 経済産業省『「AI事業者ガイドライン(第1.0版)」を取りまとめました』 https://www.meti.go.jp/press/2024/04/20240419004/20240419004.html

- 内閣府『AI法 全面施行 ―次なるフェーズへ―』 https://www.cao.go.jp/press/new_wave/20251003.html

- BUSINESS LAWYERS『日本版AI法の概要と企業への影響』 https://www.businesslawyers.jp/articles/1475

- PwC Japan『欧州(EU)AI規制法の解説―概要と適用タイムライン・企業に求められる対応』 https://www.pwc.com/jp/ja/knowledge/column/awareness-cyber-security/generative-ai-regulation10.html

- 日立コンサルティング『EU AI規則への日本企業の対応』 https://www.hitachiconsulting.co.jp/column/eu_ai_act/index.html

- デロイト トーマツ『EU AI Act – EUの包括的AI規制の概説と企業の対応』 https://www.deloitte.com/jp/ja/services/consulting/perspectives/eu-ai-act.html

- AdGuard『サムスン、ChatGPTの社内利用で情報漏洩 生成系AIのプライバシー問題』 https://adguard.com/ja/blog/samsung-chatgpt-leak-privacy.html

- 侍エンジニア『生成AIの情報漏洩事例3選|トラブルを防ぐための対策を解説』 https://generative-ai.sejuku.net/blog/5212/

- WEEL『全部わかる!ChatGPT Business(旧Team Plan)の使い方、料金』 https://weel.co.jp/media/innovator/chatgpt-team-plan/

次のコンテンツ